Der virale Weckruf

Matt Shumer hat diese Woche einen Text geschrieben, der durch die Decke gegangen ist. „Something Big Is Happening“ – fast 50 Millionen Views auf X, Fortune hat es aufgegriffen, jeder teilt es. Seine Botschaft: Wir stehen vor einer Umwälzung, größer als COVID. Die KI-Revolution läuft nicht irgendwann an. Sie ist bereits da, und die meisten Menschen haben es noch nicht bemerkt.

Shumer, Gründer eines KI-Startups, nutzt die gleiche Rhetorik wie im Februar 2020, als wenige über ein Virus in China sprachen und die Welt noch drei Wochen von der Pandemie entfernt war. Er sagt: Ihr seid in der „das scheint übertrieben“-Phase. Ihr versteht noch nicht, was kommt. Aber ich, der ich in dieser Welt lebe, ich sehe es bereits. Und ich schulde es euch, die Wahrheit zu sagen, auch wenn sie klingt, als hätte ich den Verstand verloren.

Seine zentralen Punkte sind drastisch: GPT-5.3 Codex, am 5. Februar veröffentlicht, hat sich beim eigenen Entwickeln geholfen. Rekursive Selbstverbesserung läuft. KI schreibt komplette Anwendungen, testet sie autonom, iteriert selbstständig und meldet sich erst zurück, wenn sie fertig ist. Alle Computer-Jobs sind bedroht – nicht in fünf Jahren, sondern jetzt. Die Beschleunigung ist exponentiell, die Abstände zwischen neuen Modellen schrumpfen.

Die Gegenreaktion

Gary Marcus, KI-Forscher und notorischer Skeptiker, hat Shumers Post zerlegt. „Weaponized hype“, sagt er. Marketing-Geschwafel. Shumer verschweigt die massiven Probleme: Halluzinationen, Fehlerquoten, die Tatsache, dass METR-Benchmarks 50% Erfolgsrate zeigen, nicht 100%. Er erwähnt keine der vielen Studien über Reasoning-Fehler in aktuellen Modellen. Und er hat eine Geschichte von übertriebenen Behauptungen – sein eigenes Modell hat damals nicht repliziert, viele hielten es für Betrug.

Marcus‘ Punkt: Die Realität ist messier als Shumers Story suggeriert. Ja, KI schreibt mehr Code. Aber ist dieser Code sicher? Zuverlässig? Wartbar? Eine andere METR-Studie zeigt, dass Entwickler manchmal Produktivitätsgewinne wahrnehmen, wo tatsächlich Produktivität verloren ging. Der Eindruck, dass etwas funktioniert, ist nicht dasselbe wie echte Funktion.

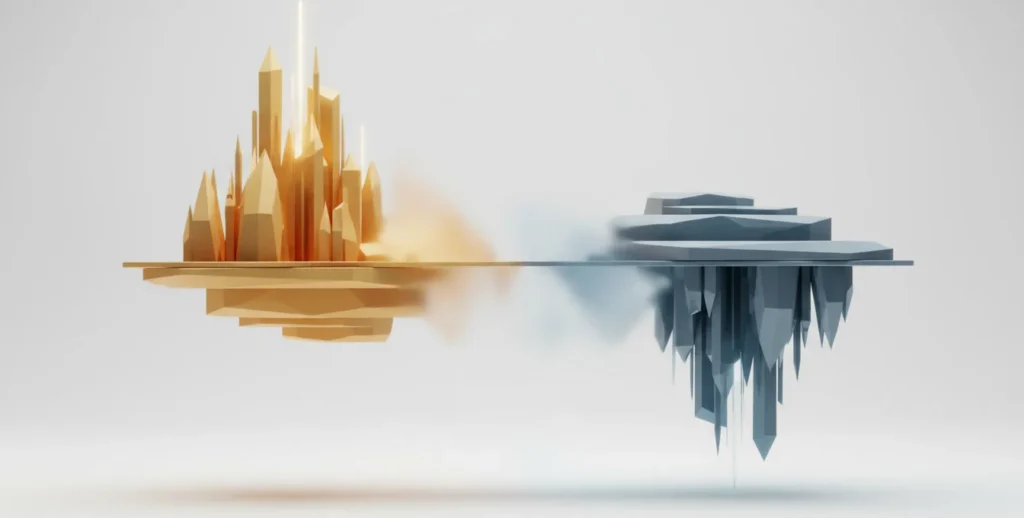

Zwei Wahrheiten gleichzeitig

Hier ist, was mich an dieser Debatte fasziniert: Beide haben recht. Nicht im Detail, aber im Kern.

Shumer hat recht, dass etwas Fundamentales passiert. Die Fähigkeit von KI-Systemen, komplexe Aufgaben autonom zu bewältigen, ist in den letzten Monaten dramatisch gestiegen. Die rekursive Komponente – KI, die KI verbessert – ist real. Anthropics CEO Dario Amodei bestätigt, dass KI „einen Großteil des Codes“ im Unternehmen schreibt und der Feedback-Loop „Monat für Monat an Fahrt aufnimmt“. Das ist kein Science-Fiction, das ist dokumentierte Gegenwart.

Aber Marcus hat genauso recht, dass die Zuverlässigkeit weit hinter dem Hype zurückbleibt. Jeder, der ernsthaft mit diesen Systemen arbeitet, kennt die Momente, in denen sie spektakulär scheitern. Wo sie Code produzieren, der aussieht wie funktionierende Software, aber subtile Fehler enthält. Wo sie mit absoluter Überzeugung völligen Unsinn behaupten. Diese Realität verschwindet nicht durch enthusiastische Erfahrungsberichte.

Die eigentliche Frage

Was bedeutet es, wenn beides wahr ist? Wenn die Fähigkeiten tatsächlich explodieren und gleichzeitig die Zuverlässigkeit fundamental unsicher bleibt?

Ich denke, wir sind in einer Phase, die genuines Unbehagen erzeugt. Nicht weil die Technologie entweder funktioniert oder nicht funktioniert, sondern weil sie in diesem unbequemen Zwischenraum existiert: Fähig genug, um echte Arbeit zu übernehmen. Nicht zuverlässig genug, um ohne menschliche Aufsicht operieren zu können. Gut genug, um Jobs zu verändern. Nicht gut genug, um Jobs zu ersetzen.

Das ist viel schwieriger zu navigieren als eine klare Disruption. Wenn KI morgen alle Entwickler-Jobs übernehmen würde, wäre das schockierend, aber klar. Wenn KI komplett versagen würde, könnten wir sie ignorieren. Aber diese schleichende Veränderung, wo die Systeme immer mehr können und gleichzeitig immer noch scheitern – das zwingt uns zu ständiger Rekalibrierung.

Warum der Hype trotzdem gefährlich ist

Shumers Rhetorik ist nicht nur enthusiastisch, sie ist strategisch. Der COVID-Vergleich, die persönliche Betroffenheit („es ist mir bereits passiert“), die Warnung an die Zurückgebliebenen – das sind klassische Techniken, um Dringlichkeit zu erzeugen. Und sie funktionieren.

Aber diese Art von Hype hat Konsequenzen. Sie treibt Menschen in Panik, die ihre Jobs bedroht sehen, ohne ihnen realistische Einschätzung zu geben. Sie treibt Investitionen in Technologie, deren Grenzen verschwiegen werden. Sie macht es schwerer, die tatsächlichen Probleme zu diskutieren – Bias, Halluzinationen, Sicherheit – weil jede kritische Stimme als „versteht es nicht“ abgetan werden kann.

Marcus‘ Kritik ist wichtig, nicht weil er Shumers Erfahrung widerlegt – die ist vermutlich echt. Sondern weil er darauf besteht, dass persönliche Anekdoten keine systemischen Aussagen ersetzen können. Dass „bei mir funktioniert es perfekt“ nicht bedeutet, dass es überall perfekt funktioniert.

Was bleibt

Die Wahrheit ist komplizierter als beide Narrative. KI-Systeme werden rapide besser. Das ist nicht übertrieben, das ist messbar. Aber diese Verbesserung folgt keiner geraden Linie zur perfekten Zuverlässigkeit. Wir könnten jahrelang in diesem Zustand bleiben: Systeme, die immer mehr können und trotzdem unvorhersehbar scheitern.

Shumers Post ist viral gegangen, weil er eine einfache Story erzählt. Aufwachen. Die Zukunft ist da. Passt euch an oder werdet zurückgelassen. Diese Stories funktionieren immer, bei jeder Technologie-Welle. Manchmal sind sie richtig. Manchmal sind sie falsch. Meist sind sie beides.

Was uns wirklich weiterbringt, ist nicht die Frage, ob Shumer übertreibt oder Marcus zu skeptisch ist. Sondern: Wie navigieren wir eine Technologie, die gleichzeitig transformativ und unreif ist? Wie bereiten wir uns auf Veränderungen vor, deren Zeitplan und Ausmaß fundamental unsicher sind?

Ich habe keine abschließende Antwort. Aber ich weiß, dass weder blinde Begeisterung noch trotzige Skepsis uns weiterbringen. Wir brauchen den Raum zwischen Panik und Gleichgültigkeit – dort, wo wir ernst nehmen können, was passiert, ohne uns von jedem Hype-Cycle mitreißen zu lassen.

Und vielleicht ist das die eigentliche Lektion: Dass die Zukunft selten so kommt, wie die Insider-Warnungen es versprechen. Aber auch selten so harmlos bleibt, wie die Skeptiker hoffen.